Intelligence artificielle : les principes de l’OCDE pour nous aider à développer une IA digne de confiance

L’intelligence artificielle (IA) transforme nos sociétés à grande vitesse. Elle restructure les systèmes éducatifs, les marchés du travail, les soins de santé, et même nos échanges démocratiques. Mais cette révolution technologique sert-elle vraiment l’intérêt général ? Peut-elle respecter les droits humains et les valeurs démocratiques ? Pour l’OCDE (L’Organisation de coopération et de développement économiques), la réponse est oui, à condition de structurer le développement et le déploiement de l’IA autour de principes clairs, flexibles et basés sur les preuves.

Pour l’OCDE (L’Organisation de coopération et de développement économiques), la réponse est oui, à condition de structurer le développement et le déploiement de l’IA autour de principes clairs, flexibles et basés sur les preuves.

Pour s’assurer que cette révolution technologique profite réellement à l’intérêt général, l’OCDE a élaboré, en 2019, un cadre de référence fondé sur des principes clairs, flexibles et centrés sur les valeurs humaines.

Chez Mieux Donner, nous partageons ce constat. C’est pourquoi nous soutenons le Centre pour la Sécurité de l’IA (CeSIA), une initiative française dédiée à sensibiliser et outiller le grand public et les politiques face aux risques liés à l’IA avancée. Nous croyons qu’il est possible de développer une IA digne de confiance, à condition d’en comprendre les implications, de surveiller ses effets et d’orienter les dons vers les projets les plus efficaces dans ce domaine.

Les principes de l’OCDE sur l’IA : un socle pour guider les acteurs de l’IA

En 2019, l’OCDE a adopté cinq principes directeurs pour encadrer le développement des systèmes d’IA. Ces principes de l’OCDE sur l’IA, également adoptés par le G20, sont aujourd’hui un cadre de référence mondial. Ils recommandent que toute IA :

- soit bénéfique pour les humains et le développement durable,

- respecte les droits humains et les valeurs démocratiques,

- repose sur la transparence, la traçabilité et l’explicabilité,

- soit techniquement robuste et sécurisée,

- engage la responsabilité des acteurs de l’IA.

Ces principes guident la mise en œuvre du code de conduite de l’OCDE sur l’IA et servent à établir des normes pour l’IA suffisamment pratiques et flexibles pour suivre l’évolution rapide des technologies.

Mesurer les capacités de l’IA : l’approche de l’OCDE

Pour permettre aux pays membres de suivre les progrès rapides de l’IA, l’OCDE a créé les AI Capability Indicators. Ces indicateurs permettent :

- d’évaluer les capacités d’un pays à développer et déployer une IA responsable,

- de comprendre les performances en matière d’innovation, de gouvernance et d’infrastructure,

- d’identifier les lacunes et de guider les politiques efficaces en matière d’IA.

Ces indicateurs sont accessibles ici.

Ce type de suivi est essentiel. Il permet de prendre des décisions fondées sur des ensembles de données solides plutôt que sur des choix réactifs. Chez Mieux Donner, cette approche fondée sur des preuves est au cœur de notre mission : nous recommandons des projets qui allient rigueur scientifique, efficacité prouvée et impact mesurable.

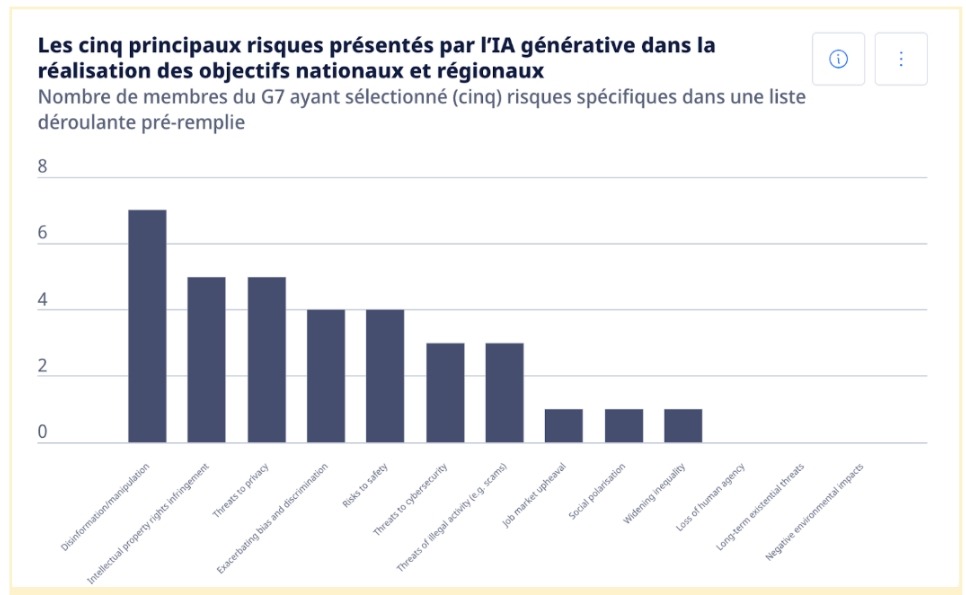

IA générative : des opportunités, mais aussi des problèmes de sécurité

L’IA générative, et en particulier les grands modèles de language, pose des défis spécifiques. L’OCDE identifie plusieurs problèmes de sécurité majeurs[1] :

- la désinformation à grande échelle,

- les atteintes à la vie privée,

- les préjugés et la discrimination générés par les algorithmes,

- la polarisation des opinions,

- la difficulté de gérer les risques liés à la traçabilité des contenus.

C’est pourquoi l’OCDE encourage la transparence algorithmique, la responsabilité, et des normes qui guident les acteurs de l’IA vers des pratiques plus sûres.

Emploi, formation et compétences humaines : l’IA transforme le travail

Selon l’OCDE, l’IA a le potentiel de transformer profondément les marchés du travail. Elle automatise certaines tâches, modifie d’autres, et exige de nouvelles compétences en IA, à la fois techniques et éthiques.

Les recommandations de l’OCDE sont claires :

- Investir dans la formation et la reconversion,

- Favoriser l’apprentissage tout au long de la vie,

- Soutenir l’acquisition des compétences nécessaires à une gestion responsable des systèmes d’IA.

IA et éducation : transformer l’apprentissage avec éthique

L’OCDE reconnaît que l’IA peut personnaliser l’enseignement, identifier plus rapidement les difficultés des élèves, et favoriser l’inclusion. Mais elle alerte aussi sur les risques : biais algorithmiques, utilisation non sécurisée des données et inégalités d’accès aux technologies.

Pour répondre à ces enjeux, les systèmes et les écoles doivent :

- intégrer l’IA de manière éthique,

- former les enseignants aux outils d’IA,

- garantir l’équité d’accès et le respect de la vie privée

Gouvernance mondiale : une responsabilité partagée

L’OCDE agit comme une plateforme de coordination internationale, en lien avec le G7, l’Union européenne, l’UNESCO et d’autres institutions majeures. Elle facilite les échanges entre les États, le monde de la science, ONG et entreprises, et encourage des mécanismes de gouvernance partagée.

Vos dons permettent de réduire les risques de l’IA

L’intelligence artificielle est l’un des domaines les plus stratégiques pour l’avenir de l’humanité. Les efforts pour développer une IA responsable doivent être soutenus par des financements ciblés, transparents et mesurables.

Le CeSIA est actuellement l’une des seules initiatives francophones à haut impact dans ce domaine. En 2024, cette association a :

- sensibilisé plus de 900 000 personnes via des campagnes en ligne,

- formé plus de 120 professionnels à la régulation de l’IA,

- accompagné le développement de modules pédagogiques sur la sécurité de l’IA dans des universités de références, comme l’ENS Ulm et l’ENS Paris-Saclay.

CeSIA s’appuie sur les dernières recherches évaluées par des pairs pour concevoir ses programmes de formation, en intégrant directement les questions clés de l’IA responsable dans ses modules. Son équipe travaille en étroite collaboration avec le monde universitaire, les institutions internationales et les élus locaux afin de les aider à relever les défis éthiques, techniques et sociaux liés à l’IA, tels que la gouvernance des systèmes d’IA, la réglementation des algorithmes, la surveillance civique et la cybersécurité.

Convaincu qu’une société bien informée est mieux à même d’exiger une IA respectueuse des droits humains et des libertés fondamentales, le CeSIA propose des formats hybrides et des ateliers pratiques en entreprises et institutions pour accompagner la mise en œuvre des recommandations de l’OCDE sur les risques de demain.

En créant un véritable pont entre la recherche académique, le monde politique et la société civile, et grâce à ses partenariats avec des institutions internationales, le CeSIA renforce ainsi les capacités humaines plutôt que de les déléguer aveuglément à la technologie, tout en relayant activement les politiques efficaces préconisées par l’OCDE.

Ces résultats sont rendus possibles grâce à des dons privés. En soutenant le CeSIA, vous contribuez à développer une IA qui soit digne de confiance, qui respecte les droits humains, et qui renforce les capacités humaines plutôt que de les remplacer.

Ce que vous pouvez faire aujourd’hui

- Visitez la page du programme CeSIA : mieuxdonner.org/cesia

- Explorez la plateforme OECD.AI pour découvrir les outils et publications de l’OCDE sur l’IA

- Soutenez Mieux Donner pour aider à structurer des initiatives philanthropiques qui ont un impact mesurable sur l’avenir de l’IA.