Évaluer l’impact : au-delà des chiffres, une approche scientifique et nuancée

Les analyses coût-efficacité, ou cost-effectiveness analysis (CEA) sont parmi les outils les plus puissants dont nous disposons pour orienter nos dons. Elles permettent d’évaluer et de comparer différentes interventions en mesurant les résultats par rapport aux coûts.

Chez Mieux Donner, nous produisons rarement nos propres analyses, mais nous sélectionnons les meilleures évaluations disponibles, réalisées par des organismes indépendants comme GiveWell ou Giving Green. Notre rôle est d’identifier les interventions ayant le plus grand impact mesuré et de rendre ces informations accessibles.

Mais si les analyses coût-efficacité sont un outil essentiel, elles ne doivent pas être prises au pied de la lettre. Une lecture naïve des résultats peut conduire à des erreurs : comparer des chiffres qui ne sont pas comparables, négliger les incertitudes, ou oublier des éléments difficilement quantifiables. Nous utilisons ces analyses avec rigueur, en tenant compte de leurs limites, et nous les complétons par d’autres approches pour prendre des décisions éclairées.

Cet article explore notre approche : comment nous utilisons les analyses coût-efficacité, pourquoi nous simplifions parfois nos messages pour mieux sensibiliser, et comment nous évitons les erreurs classiques en intégrant d’autres outils d’évaluation.

1. Comprendre les analyses coût efficacité

Définition

Une analyse coût-efficacité (ou CEA pour cost-effectiveness analysis) est une méthode qui compare plusieurs actions possibles en fonction de leur coût et de leur impact mesuré, sans chercher à monétiser directement cet impact. On l’utilise surtout quand l’effet recherché n’a pas de valeur marchande évidente : par exemple, combien coûte-t-il d’éviter une naissance prématurée, de restaurer un an de vue, ou d’éviter une tonne de CO2. Ce type d’analyse permet de classer les actions selon leur efficacité relative.

À la différence d’une analyse coût-bénéfice, la CEA ne cherche pas à tout traduire en euros. Elle garde une forme d’humilité en distinguant clairement les coûts (dépenses) et les effets (résultats concrets, comme la santé ou la scolarisation). Concrètement, elle permet de répondre à une question simple mais décisive : si je veux obtenir tel impact, quelle est la manière la plus efficace d’y parvenir avec mes ressources limitées ? On peut aussi l’utiliser dans une variété de domaines, comme l’éducation, la santé, l’environnement ou l’aide au développement.

Exemple d’une distribution de vitamines A au Burkina Faso

Dans les pays pauvres, de nombreuses personnes souffrent de carence en vitamine A. Il s’agit d’une des principales causes de cécité évitable dans le monde. Elle commence par une carence en ce nutriment vital, qui affecte les enfants, en particulier ceux qui vivent dans des conditions de mauvaise alimentation et d’accès limité aux soins de santé. S’il n’est pas traité, un enfant souffrant d’une carence en vitamine A commencera à souffrir de cécité nocturne et, avec le temps, pourra devenir aveugle.

Cependant, il existe une solution très peu coûteuse qui permet d’éviter que cette maladie ne se développe : fournir des suppléments de vitamine A. On peut se demander si cette intervention marche réellement bien. Si par exemple, pour le même coût, elle permet de sauver plus de vies que des actions en France où le coût statistique de sauver une vie est d’en moyenne 3 millions d’euros. Voire pour se demander si cela permet d’aider davantage que d’investir la même somme dans une autre intervention dans le même pays.

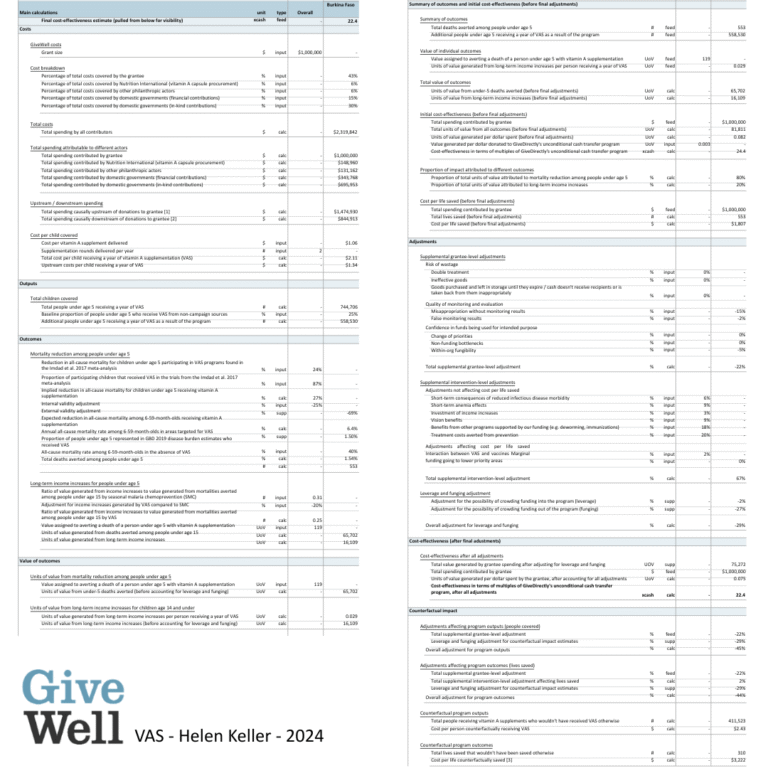

Regardons une analyse faite par GiveWell, le principal évaluateur international des questions de santé et pauvreté, du coût efficacité du programme de distribution de vitamines A implémenté par Helen Keller international au Burkina Faso:

Les analyses de GiveWell sont parmi les plus détaillés, elles se basent régulièrement sur des essais randomisés controlées, les études scientifiques les plus rigoureuses permettant le plus haut niveau de confiance. Elles sont publiques, peuvent etre utilisées par des spécialistes du secteur, garantissent que l’impact final est élévée et que votre soutien peut réellement faire la différence. Cependant avec leur 170 lignes de calculs, leurs multiples excel secondaires et le lien de dizaines d’études académiques, leur analyse ne sont pas accessibles au grand public.

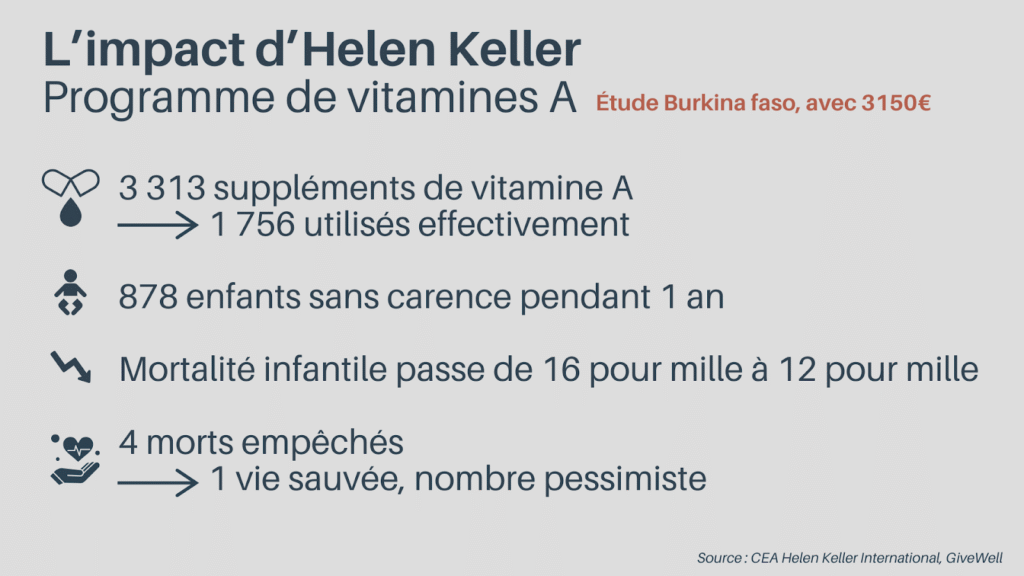

Voici une version simplifiée :

Ce type d’analyse nous permettent de comprendre quels sont les effets finaux engendrés par une certaine somme et donc de comparer des interventions différentes. Et le programme de distribution de vitamines A mené par Helen Keller fait partie des intevrntions les plus efficaces pour améliorer la santé. Il en est de même pour les autres associations recomandées pour les questions de santé et pauvreté sur notre site.

2. La force des analyses coût-efficacité

Les analyses coût-efficacité permettent de comparer différentes interventions en évaluant leur rapport entre l’impact attendu et les ressources investies. Dans un monde où les besoins dépassent largement les ressources disponibles, choisir où et comment agir n’est pas une question abstraite, mais un arbitrage concret ayant des conséquences réelles sur la vie des bénéficiaires.

Grâce aux analyses coût-efficacité :

- Nous évitons les intuitions trompeuses : Il est souvent difficile d’anticiper l’impact réel d’une action. Ce n’est pas parce qu’une intervention semble efficace qu’elle l’est réellement. Les analyses nous permettent de nous affranchir des biais cognitifs et d’adopter une approche plus rationnelle.

- Nous facilitons la prise de décision : Ces analyses apportent une grille de lecture claire qui aide à orienter les financements vers les solutions ayant le plus grand potentiel.

- Nous identifions des interventions sous-estimées : Certaines actions sont extrêmement efficaces mais peu connues ou peu financées. En les mettant en avant, nous pouvons orienter davantage de ressources vers des solutions à fort impact.

- Nous pouvons prioriser les actions : Toutes les interventions ne se valent pas. Certaines aident concrètement des milliers d’individus, tandis que d’autres nécessitent des sommes bien plus importantes pour un bénéfice moindre.

Cependant, comme tout outil, ces analyses ont des limites et doivent être utilisées avec précaution.

3. Vulgariser l’impact : pourquoi nous donnons des chiffres précis

Dans notre communication, nous faisons souvent des affirmations très directes et percutantes, comme « Cette intervention est 350x plus efficace que celle-ci » ou « 1 € permet de protéger 5,3 animaux d’élevage ». Ce type de formulation peut sembler simpliste, mais elles remplissent un rôle essentiel : aider les personnes motivées par leur impact à prendre conscience des écarts d’impact entre les différentes actions philanthropiques et leur donner des repères pour mieux choisir.

Un objectif de communication scientifique

Nous sommes une association de communication scientifique, et comme tout effort de vulgarisation, nous devons traduire des analyses complexes en messages clairs et compréhensibles.

Lorsqu’un média annonce « Fumer un paquet par jour réduit l’espérance de vie de 10 ans », personne ne demande à voir précisément les 10 années perdues. De la même manière, lorsqu’on dit « Un euro permet de sauver 5,3 animaux », cela ne signifie pas qu’un individu peut pointer précisément les 5,3 animaux qui ont été sauvés, mais que c’est l’impact attendu d’un don sur la base des meilleures estimations disponibles.

Aider les personnes à prendre des décisions éclairées

Pour que les individus puissent choisir où donner en toute connaissance de cause, il est essentiel de leur donner des outils de comparaison. Nous savons que les différences d’impact entre les interventions sont immenses, parfois d’un facteur 10, 100 ou même plus. Pourtant, sans comparaison chiffrée, il est difficile de percevoir ces écarts et d’en tirer des conclusions. Sans ces repères, les personnes risquent d’orienter leurs dons vers des interventions qui « semblent bien » plutôt que vers celles qui ont le plus grand impact réel.

Bien sûr, cette communication simplifiée ne reflète pas toutes les incertitudes et nuances des analyses. Mais c’est un compromis nécessaire pour rendre l’information actionnable. Comme tout travail de vulgarisation, cela implique des simplifications, mais qui restent basés sur des données rigoureuses et des méthodologies transparentes.

Donner un ordre de grandeur de l’impact attendu

Les personnes ont naturellement tendance à sous-estimer l’impact que les dons efficaces peuvent avoir, notamment à cause de l’insensibilité à l’ampleur et du biais de la victime identifiable.

Lorsqu’une personne entend parler de 10 000 vies sauvées, elle ne ressent pas émotionnellement la différence avec 100 vies sauvées, même si l’impact est 100 fois plus grand. De même, nous avons spontanément plus envie d’aider une personne identifiable en détresse qu’un programme qui sauve efficacement des milliers de vies. Ces biais entraînent souvent des décisions de dons moins efficaces qu’elles pourraient l’être.

C’est pourquoi nous communiquons avec des chiffres clairs et percutants : pour donner aux indivudus une vision plus juste des différences d’impact et les inciter à agir en conséquence. Bien sûr, nous reconnaissons que ces chiffres comportent une marge d’incertitude, mais ils restent une approximation utile, infiniment plus informative que l’absence totale de repères. En utilisant ces estimations, nous permettons aux individus de voir concrètement l’impact potentiel de leur générosité, et nous les aidons à orienter leurs ressources là où elles auront le plus d’effet.

Trop de certitudes ? Le défi de la vulgarisation

Nous reconnaissons que nos affirmations sont parfois présentées avec plus de certitude qu’elles n’en ont en réalité. Mais il y a une raison à cela : si nous insérons trop d’incertitudes dans nos messages, il serait très difficile de promouvoir la générosité efficace au grand public.

Par exemple, si nous disions à chaque phrase :

« Nous estimons, avec une marge d’erreur non négligeable, que sous certaines hypothèses méthodologiques, il est possible qu’un don de 100 € permette de vacciner 5 personnes supplémentaires, bien que les intervalles de confiance varient et que certaines hypothèses puissent être remises en question »,

nous perdrions complètement l’effet mobilisateur et éducatif de notre message.

Cela ne signifie pas que nous négligeons ces incertitudes. Elles sont d’ailleurs souvent prises en compte en réduisant la valeur mise en avant et nous préférons toujours utiliser les hypothèses les plus prudentes. Les analyses peuvent comporter des marges d’erreur, des réductions multiples et des analyses de sensibilité, mais elles considèrent toujours l’impact à la marge, et nous cherchons à vérifier les hypothèses avec d’autres évaluations indépendantes.

Notre engagement : rigueur scientifique et transparence

Nous nous engageons à rester transparents sur notre méthodologie et à publier nos raisonnements complets. Nos chiffres ne sont ni des vérités absolues, ni des slogans vides, mais des estimations raisonnées, fondées sur les meilleures données disponibles, qui permettent de mieux comprendre où nos dons peuvent faire la différence.

Nous veillons à ce que chaque chiffre affiché sur notre site soit accompagné de sa source. Si vous remarquez qu’une source manque ou si vous pensez qu’un chiffre devrait être revu à la lumière de nouvelles informations, n’hésitez pas à nous le signaler. Nous mettons un point d’honneur à actualiser nos estimations et à intégrer des sources de qualité.

Par exemple, sur les questions de santé et de lutte contre la pauvreté, nous nous appuyons sur les évaluations de GiveWell, qui sont publiques et entièrement accessibles. Nous souhaitons que vous puissiez explorer la rigueur derrière nos recommandations.

4. Notre utilisation scientifique des analyses coût-efficacité

Si nos messages sont parfois simplifiés dans notre mission de vulgarisation, notre travail d’analyse, lui, est rigoureux et nuancé. Nous savons que les analyses coût-efficacité (CEA) ont des limites et qu’elles ne doivent pas être prises au pied de la lettre. C’est pourquoi nous adoptons plusieurs précautions dans leur utilisation et complétons ces analyses par d’autres outils.

Nos principes et les erreurs à éviter

Comparer des interventions avec des méthodologies similaires

Les CEA sont souvent réalisées selon des méthodologies différentes, ce qui peut fausser les comparaisons. Comparer une intervention évaluée par GiveWell avec une intervention évaluée par la Banque Mondiale peut induire en erreur, car les critères et hypothèses divergent.

Nous nous assurons que les comparaisons sont faites entre interventions évaluées selon des approches compatibles et rigoureuses, et nous identifions clairement les différences méthodologiques lorsqu’elles existent.

Prendre en compte l’incertitude et les marges d’erreur

Les résultats d’une analyse coût-efficacité (CEA) sont souvent présentés sous forme de chiffres précis, mais en réalité, ils doivent être interprétés comme des plages de valeurs tenant compte d’une incertitude significative.

Sans prendre en compte les marges d’erreur, nous risquerions de tirer des conclusions erronées. Par exemple, selon la dernière évaluation de GiveWell, les dons au programme de distribution de vitamines A par Helen Keller International auraient 8 % d’impact positif supplémentaire par rapport à la distribution de moustiquaires par Against Malaria Foundation (AMF). Si nous nous en tenions uniquement à cette différence apparente, nous pourrions être tentés de retirer AMF de nos recommandations, en considérant qu’elle est moins efficace. Cette interprétation serait une erreur, car cet écart n’est pas significatif connaissant la marge d’erreur.

Négliger les risques ou se contenter de les estimer

Si une intervention a des conséquences positives fortes, il faut aussi se demander si elle a des conséquences négatives, soit directement ou indirectement. Typiquement, si l’État d’un pays à faible revenus mène un programme de vaccination, mais qu’il manque de ressources ou de stabilité, il se pourrait qu’une association soit plus efficace pour mettre en place ce programme, et qu’il semblerait opportun de financer cette association.

Mais si cela se fait en parallèle d’une activité fonctionnelle de l’État, cela pourrait conduire le gouvernement à se désengager de ce projet et potentiellement perdre sa capacité d’action à l’avenir sur les questions de santé. Il ne faudrait pas ignorer cette possibilité et activement chercher des alternatives, par exemple, recruter des personnes connaissant le contexte local et pouvant se former aux meilleures pratiques pour les partager avec les services de l’État en question.

Un autre aspect sur lequel une lecture naive d’une analyse cout efficacité peut avoir des conséquences nettes négatives serait de pondérer les conséquences négatives comme si c’était un paramètre comme un autre. Se dire “pour mener cette intervention, nous allons devoir mentir et blesser de nombreuses personnes mais au final cela devrait avoir des conséquences positives énormes” est un excellent moyen d’avoir un impact négatif.

Nous vivons dans un monde complexe, chercher à aider les autres ne doit pas se faire en ignorant des principes universels de base tel que « ne pas mentir , ne pas blesser… » et il faut se montrer sceptique si des risques ou des conséquences négatives font partie des paramètres. Pour reprendre l’exemple de la vaccination, nous acceptons des risques de maux de tête pour les immenses bénéfices créés par les vaccins, mais il a fallu de nombreuses études pour confirmer cela pour chaque vaccin. De manière générale, il faut appliquer un principe de vigilance.

Éviter le financement redondant

Il est tentant de financer des interventions qui semblent très efficaces, comme par exemple fournir un stylo à la direction de l’Agence Française du Développement pour qu’elle puisse signer des contrats d’aide internationale– ce qui semble être une contribution précieuse car les signatures vont permettre d’aider des millions de personnes.

Mais vu que d’autres acteurs étaient déjà prêts à financer cette dépense, notre apport ne permet pas d’avoir d’impact supplémentaire : on ne peut pas s’attribuer la réussite des vies sauvées par l’aide internationale française en offrant un stylo. Dans ce cas, ce don ne libère que quelque euros à l’acteur qui aurait payé et votre impact sera ce qu’il fera avec cette somme (qui aura certainement moins d’impact).

Lorsque nous évaluons une intervention, nous nous demandons si notre financement apporte une réelle valeur ajoutée ou s’il se contente de remplacer un financement qui aurait existé sans notre contribution. Si un gouvernement ou une institution majeure aurait financé cette action de toute façon, alors notre don n’a pas l’impact additionnel souhaité.

Dans ses évaluations, GiveWell prend cela en compte en regardant si une intervention aurait été financée en l’absence de don privé. Ils examinent les engagements des gouvernements et des grandes institutions, analysent des subventions passées qui ont failli être financées par eux pour voir si elles ont finalement été prises en charge par un autre acteur. Le constat est souvent que de nombreuses interventions considérées n’ont finalement pas été financées [1]. Cela signifie que les dons additionnels peuvent réellement combler un manque, en soutenant des interventions qui, sinon, n’auraient pas eu lieu.

Nous pensons donc en termes marginaux et contrefactuels : au lieu de regarder un programme de manière isolée, nous évaluons ce qui se passerait sans notre don. Nous choisissons des interventions où chaque euro supplémentaire permet d’accomplir un changement qui n’aurait pas eu lieu autrement. Nous nous assurons que nos recommandations comblent des lacunes réelles et créent un impact additionnel tangible.

Aller au-delà des chiffres : des outils complémentaires

Les CEA sont précieuses, mais elles ne doivent pas être la seule boussole. D’autres outils permettent d’affiner nos décisions :

- Modèles de pondération des facteurs (Weighted Factor Models) : Ils intègrent des dimensions non quantifiables comme la faisabilité politique, l’acceptabilité sociale ou les effets secondaires.

- Approche Ampleur, potentiel d’amélioration et caractère négligé : Une part significative de l’impact dépend de la cause traitée – bien-être animal, changement climatique ou stabilité géopolitique, par exemple. Nos évaluateurs s’appuient sur les critères suivants :

- Ampleur : le problème que cherche à résoudre le moyen d’action touche-t-il un grand nombre d’individus ? A quel point les individus touchés sont-ils impactés ?

- Potentiel d’amélioration : quelle part du problème peut être résolue de façon efficace ?

- Caractère négligé : quelle quantité de ressources est déjà dédiée à ce problème ?

- Itération progressive : Les évaluations commencent par une analyse rapide sur de nombreuses interventions, puis approfondissent les plus prometteuses.

- Avis de spécialistes : Certains domaines sont difficiles à quantifier. Nous intégrons donc les avis de spécialistes pour compléter les CEA et éviter de surestimer notre confiance dans les modèles.

Nous détaillons comment prioriser au delà des chiffres dans un article précédant.

Un équilibre entre rigueur scientifique et communication efficace

Chez Mieux Donner, nous utilisons les analyses coût-efficacité avec rigueur et nuance, sans tomber dans l’excès de précision ni dans la simplification abusive.

Dans notre communication, nous simplifions parfois les résultats pour les rendre accessibles et actionnables.

Dans nos analyses, nous adoptons une approche scientifique rigoureuse, en tenant compte des incertitudes et en évitant les erreurs classiques.

L’objectif n’est pas de chercher une précision illusoire, mais d’utiliser les meilleurs outils disponibles pour prendre les meilleures décisions possibles. Notre mission est d’aider les individus à allouer leurs ressources de la manière la plus efficace et éthique possible, et cela passe par une utilisation éclairée des analyses coût-efficacité.