Impact

Le mythe de la mesure d'impact en France : une illusion qui coûte cher

La mesure d'impact en France, telle qu'elle est actuellement pratiquée, apparaît comme une illusion qui détourne les ressources et maintient un statu quo inefficace, au détriment des personnes les plus démunies.

Romain Barbe

Co-fondateur · Mieux Donner · Temps de lecture : 12 min

Introduction

Il semblerait qu'en France, la mesure d'impact soit devenue la nouvelle norme pour chaque projet associatif. Partout, on voit fleurir des cabinets de conseil spécialisés, les associations se dotent de « responsables impact » et des fonds de dotation affichent fièrement leur volonté d'améliorer l'effet de leurs financements et se qualifient eux-mêmes « à impact ». Ce foisonnement donne l'impression d'un véritable essor dans la manière d'évaluer l'impact réel des interventions. Pourtant, derrière cette apparente effervescence se cache une réalité bien plus nuancée, voire alarmante : une grande partie de ce qui est vendu sous le terme « mesure d'impact » manque de rigueur, voire peuvent être de simples outils de communication.

Pour certains, la mesure d'impact sert à vérifier que l'action menée produit certains effets intermédiaires ou s'inscrit dans une logique d'amélioration continue. Mais cela passe à côté de l'essentiel : aider les bénéficiaires. Pour cela, il faut regarder l'impact final sur le public cible et utiliser des mesures claires, objectives et comparables. Il ne s'agit pas seulement d'identifier des pistes d'amélioration, mais aussi – et surtout – de pouvoir fermer les programmes qui ne montrent pas d'impact social et d'orienter les ressources vers ceux qui aident davantage.

Il est important de souligner que ces pratiques ont pour principales victimes les personnes dans le besoin. En effet, lorsque les évaluations ne permettent pas de comparer objectivement les interventions, il devient impossible d'allouer les ressources de manière à véritablement venir en aide aux plus démunis.

Plusieurs raisons peuvent expliquer cette situation en France :

- La mesure d'impact comme justification : la mesure d'impact en France sert avant tout à justifier des financements existants plutôt qu'à orienter de nouveaux arbitrages pour améliorer l'efficacité de l'aide.

- Un décalage des intérêts des acteurs : Les cabinets de conseil, dont le modèle économique repose sur des évaluations sur-mesure, ont peu d'incitations à adopter des méthodes comparables et standardisées qui permettraient de réellement orienter les financements.

- Un manque de connaissances ou d'ouverture à l'international : De nombreux acteurs français ne consultent pas la littérature scientifique – aussi bien la littérature blanche que grise – produite par des organisations telles que Founders Pledge ou GiveWell, qui offrent pourtant des méthodologies rigoureuses.

- Une approche culturelle différente de la philanthropie : En France, la culture scientifique n'a pas intégré tous les domaines de la société et le don repose davantage sur l'intention que sur l'efficacité à l'opposé d'analyses rigoureuses basées sur des preuves.

Dans cet article, nous proposons d'examiner en profondeur les pratiques actuelles de mesure d'impact en France, en les comparant aux méthodes rigoureuses appliquées à l'international. Nous analyserons les écarts, leurs conséquences pour les bénéficiaires – souvent les plus démunis – et nous proposerons des pistes de réformes pour que la mesure d'impact serve réellement à orienter les financements vers les interventions les plus efficaces.

1. Ce qui se fait en France et ce qui devrait être fait pour mesurer l'impact

1.1 Un boom apparent mais une réalité bien décevante

L'effervescence du marché de la mesure d'impact

Aujourd'hui, on pourrait croire qu'il y a un véritable boom de la mesure d'impact en France. Des cabinets de conseil spécialisés se multiplient, et les associations, sous la pression des financeurs et du grand public, se dotent de « responsables impact » pour prouver qu'elles font la différence. Il existe maintenant des réseaux regroupant des centaines de praticiens de la mesure d'impact et d'organisation.

Pourtant, cette prolifération d'initiatives masque une réalité beaucoup plus crue : la plupart des méthodes utilisées reposent sur des évaluations qualitatives, souvent sur-mesure, qui mettent en avant des indicateurs flous – comme le pourcentage de dons allant directement aux bénéficiaires ou le nombre de personnes « aidées » – sans véritablement mesurer le coût réel par unité d'impact.

Une mesure d'impact au service de la justification

Une des dérives majeures de cette approche est que la mesure d'impact est souvent utilisée pour justifier des financements déjà existants plutôt que pour orienter de nouveaux arbitrages. L'idée de retour social sur investissement (SROI – Social Return on Investment) pourrait constituer une avancée notable. En théorie, elle permettrait de comparer différentes interventions et d'orienter les financements vers celles qui offrent le meilleur rendement social. En pratique, cependant, cette notion est trop utilisée avec des méthodes disparates de manière ponctuelle. Plutôt que de permettre une comparaison objective, le SROI sert principalement à légitimer un projet déjà en place, sans jamais questionner s'il existe une alternative plus efficace.

Un autre problème lié à ce système est que les résultats des évaluations restent majoritairement confidentiels. Il n'existe quasiment aucun partage entre les structures, ce qui rend impossible toute analyse comparative. Chaque association finance sa propre étude isolée, dont la conclusion se résume généralement à « impact très élevé, continuez ce que vous faites » sans jamais recommander une réallocation des fonds vers des projets plus performants. Ce cercle vicieux conduit à un statu quo où chacun continue à agir « comme il le sait déjà », sans réellement tenir compte des besoins des bénéficiaires ni de la performance relative des interventions.

1.2 Les limites des approches classiques et le manque de rigueur

Le suivi et évaluation (S&E)

Le suivi et évaluation (S&E) est un processus essentiel pour toute organisation cherchant à structurer son action et à assurer la transparence de ses activités. Le suivi consiste à collecter des données sur la mise en œuvre d'un programme (ex. : nombre de bénéficiaires touchés, volume d'activités réalisées), tandis que l'évaluation vise à analyser les effets de ces actions et à en tirer des enseignements. Les effets analysés ne reflètent pas toujours l'impact final recherché mais souvent des indicateurs intermédiaires observables sur le terrain. Ces deux étapes sont une base indispensable pour piloter un projet, garantir son efficacité opérationnelle et optimiser les ressources allouées.

De nombreuses organisations se concentrent uniquement sur le suivi des activités mises en place (nombre de bénéficiaires touchés, quantité de services fournis) sans se demander si ces interventions ont réellement amélioré la situation des bénéficiaires.

Prenons un cas d'étude fictif :

Cas d'étude : distribution de livres scolaires

Approche S&E (Suivi et Évaluation)

Une fondation finance un programme de distribution gratuite de livres pour des enfants défavorisés. L'évaluation indique que 5 000 livres ont été achetés, 99 % ont été livrés, et que de nombreux enfants les ont désormais dans leur chambre. Sur cette base, le projet est considéré comme un succès.

Approche centrée sur l'impact

Plutôt que de s'arrêter au nombre de livres distribués, une analyse de l'efficacité de l'intervention poserait des questions clés : cette initiative a-t-elle réellement amélioré les taux d'alphabétisation ? Dans quelle mesure, et comparée à d'autres options disponibles ?

Il pourrait s'avérer que la promotion de messages positifs vers les parents augmente davantage la fréquentation scolaire et les résultats en lecture, et ce, à un coût inférieur à celui de la distribution de livres. Dans cette optique, si l'objectif est d'améliorer l'éducation de la manière la plus efficace possible, les ressources devraient être réallouées en conséquence.

Il est cependant important de noter que le suivi et l'évaluation restent indispensables pour assurer un impact réel : par exemple, en mesurant le nombre de traitements administrés et pris pour évaluer leur efficacité. L'approche basée sur l'impact ne remplace pas le suivi des activités, mais l'intègre dans une réflexion plus large sur la meilleure façon d'atteindre les objectifs fixés.

Exemple de bonne pratique internationale

Against Malaria Foundation (AMF), distribuant des moustiquaires imprégnées d'insecticide pour lutter contre le paludisme, est souvent citée comme un modèle de rigueur en matière de suivi et évaluation (S&E) et d'impact mesurable. Chaque

don est tracé et chaque étape de l'intervention est scrutée. AMF publie en ligne des données détaillées sur les distributions, avec des cartes, des photos et des rapports de suivi. Ce qui rend AMF exceptionnel n'est pas son S&E en soi, mais que l'organisation se sert de ses capacités pour des interventions qui ont des impacts prouvés sur la santé et la lutte contre le paludisme.

Les indicateurs sur-mesure et l'absence de standardisation

À l'international, les évaluateurs utilisent des indicateurs standardisés tels que les DALY, LAYS et WELLBY pour mesurer de manière objective l'impact d'une intervention, permettant ainsi une comparaison directe entre des projets très différents :

DALY

Disability-Adjusted Life Years

Nombre d'années de vie en bonne santé perdues à cause d'une maladie ou d'un handicap.

LAYS

Learning-Adjusted Years of Schooling

Mesure de l'efficacité réelle d'une année scolaire en tenant compte de l'apprentissage effectif.

WELLBY

Well-Being Adjusted Life Years

Évaluation de l'impact d'une intervention sur la qualité de vie perçue.

tCO₂e

Tonnes de CO₂ équivalent évitées

Émissions de CO₂ évitées par une intervention.

En France, force est de constater que la majorité des évaluateurs se contentent de créer des indicateurs sur-mesure pour chaque projet. Cette approche, bien que personnalisée, empêche toute comparaison entre les interventions, rendant impossible une priorisation rationnelle des actions. Par conséquent, il devient difficile pour les financeurs de savoir où leurs fonds pourraient avoir un impact nettement supérieur.

L'absence de raisonnement contrefactuel

Un autre écueil majeur réside dans l'absence quasi systématique du raisonnement contrefactuel dans les évaluations françaises. Pour mesurer l'impact réel, il est indispensable de comparer ce qui s'est produit avec et sans l'intervention. Par exemple, une association qui distribue des fournitures scolaires pourrait sembler très efficace, mais sans analyser ce qui se serait passé en l'absence de cette distribution, on risque de surestimer son impact par exemple si les personnes avaient déjà des fournitures ou si elles avaient prévu d'en acheter. Cette lacune empêche d'identifier les écarts réels et d'orienter les financements vers les interventions les plus efficaces.

La prédominance des approches qualitatives

En France, la mesure d'impact se base majoritairement sur des évaluations qualitatives, telles que des enquêtes de satisfaction et des études de cas illustratives. Ces approches valorisent souvent les « belles histoires » et la perception positive des bénéficiaires, sans jamais quantifier l'impact en termes d'unités comparables. Ce choix méthodologique, qui privilégie une validation du projet plutôt qu'une analyse comparative, conduit à un manque de rigueur scientifique et empêche une allocation plus éclairée des ressources.

Nous mettons en avant les approches quantitatives car elles peuvent être utilisées dans plus de cas que ce que nous pensons, mais il est possible de prioriser au-delà des nombres.

L'absence de preuves scientifiques

Les meilleures associations se distinguent par leur capacité à s'appuyer sur des preuves scientifiques robustes. Elles utilisent notamment des essais contrôlés randomisés (RCT) et des méta-analyses pour démontrer l'efficacité de leurs actions. Ces pratiques permettent de mesurer de façon précise le coût par vie sauvée ou par DALY évité. Malheureusement, en France, très peu d'évaluateurs adoptent ces méthodes rigoureuses. La majorité des évaluations se base sur des évaluations sans méthode scientifique, ce qui limite la capacité de comparer objectivement l'impact des interventions et de prioriser les financements en conséquence.

Un manque d'arbitrage et une diffusion insuffisante

L'évaluation de l'impact en France souffre d'une fragmentation excessive, où chaque organisation mène ses propres études sans cadre commun. Cette multiplication des évaluations entraîne des coûts supplémentaires, qui pourraient être mieux investis dans les interventions elles-mêmes. De plus, l'absence de standardisation empêche toute comparaison rigoureuse entre projets, rendant difficile l'identification des actions les plus efficaces. Des études montrent qu'il est souvent possible d'aider 100 fois plus de personnes dans une même cause avec un budget identique, mais ces opportunités restent largement inexplorées faute d'un système d'évaluation véritablement comparatif.

Ce problème est aggravé par la diffusion limitée des résultats. Contrairement à des évaluateurs comme GiveWell, qui publient intégralement leurs analyses pour permettre la critique et la comparaison, les cabinets français gardent généralement leurs études confidentielles. Ce manque de transparence empêche une mutualisation des connaissances et limite la capacité des financeurs à réorienter efficacement leurs financements vers les interventions les plus rentables. En conséquence, les évaluations servent plus souvent à justifier des financements existants qu'à remettre en question les choix actuels et à optimiser l'impact des ressources allouées.

1.3 Ce qui peut être fait par les associations

Contrairement à ce que laissent penser les discours dominants en France, évaluer l'impact d'un projet ne nécessite pas un budget exorbitant ni des années de recherches sur-mesure menées par des consultants externes. Des outils existent, des bases de données sont accessibles, et des méthodes rigoureuses sont déjà utilisées ailleurs. Voici quelques bonnes pratiques pour évaluer rapidement l'impact d'une intervention sans gaspiller du temps et des ressources.

Vérifier si un projet similaire a déjà été évalué

Avant de financer une coûteuse évaluation d'impact, il faut d'abord répondre à une question évidente : quelqu'un a-t-il déjà évalué un projet similaire ailleurs ?

Les cabinets de conseil en France semblent ignorer qu'une grande partie du travail d'évaluation a déjà été faite à l'international. Des projets d'éducation, de lutte contre la pauvreté ou de santé publique ont déjà été évalués avec des méthodologies robustes. Il suffit souvent de faire une recherche en anglais pour trouver des résultats exploitables, mais ce simple réflexe est trop souvent négligé – faisant qu'on finance des projets qui n'aident peu, voire pas les bénéficiaires.

S'informer pour comprendre les bases de la mesure d'impact

Charity Entrepreneurship propose un processus avec une première évaluation en dix minutes, avec quelques colonnes et des notes en fonction de critères pertinents, pour obtenir un ordre de grandeur. Avec une feuille de calcul un peu plus détaillée, une pré-évaluation peut être affinée en une heure ou deux, permettant ainsi aux décideurs de mieux orienter les financements. Investir ce temps en amont est un moyen simple d'éviter des coûts élevés sur le long terme en assurant que les ressources sont utilisées efficacement.

S'appuyer sur les publications scientifiques et les ressources fiables

Les publications académiques et les analyses d'organisations spécialisées sont une mine d'or pour quiconque veut comprendre l'impact réel d'une intervention. Pourtant, elles sont très peu exploitées par les acteurs français de la mesure d'impact.

Certaines ressources sont pourtant particulièrement précieuses pour identifier des projets à haut impact :

- Les essais contrôlés randomisés (RCTs) : Ces études permettent d'isoler l'effet causal d'une intervention en la comparant à un groupe témoin.

- Consulter les méta-analyses : Une intervention évaluée une seule fois peut être trompeuse. Croiser plusieurs études permet de mieux juger de l'efficacité d'un projet.

Chercher dans les bases de données académiques : Google Scholar, ResearchGate ou SSRN regroupent des milliers de publications en accès libre.

Évaluateurs indépendants et organismes de recherche :

Pionnier de l'évaluation coût-efficacité des associations caritatives. GiveWell publie des analyses détaillées sur les associations les plus efficaces.

Innovations for Poverty Action et J-PAL

Recensent des résultats d'essais contrôlés randomisés sur des centaines d'interventions.

Identifie les meilleures opportunités de dons pour les entrepreneurs et philanthropes. Publie des rapports approfondis sur des causes prioritaires comme le climat ou la lutte contre la pauvreté.

Produit des études rigoureuses sur des interventions en santé, bien-être animal et climat.

Dans bien des cas, une simple lecture critique de ces ressources permettrait de prendre des décisions bien plus éclairées – et à moindre coût.

Lire les ressources de la communauté de l'altruisme efficace

L'altruisme efficace est une démarche qui allie empathie et rationalité pour identifier les interventions ayant le plus grand impact positif. Contrairement aux approches traditionnelles, cette communauté adopte une méthode scientifique rigoureuse pour orienter les ressources vers les solutions les plus efficaces.

Les ressources du Effective Altruism forum sont nombreuses : des milliers de posts sur les meilleures méthodes d'évaluation et de priorisation, des débats sur les critères à utiliser et les bonnes pratiques.

Pourquoi cette communauté est précieuse pour mieux orienter nos ressources ?

- Un état d'esprit qui se dit qu'il vaut mieux aider plus que moins : Chaque euro doit être orienté là où il peut avoir le plus d'impact.

- Une transparence absolue : Les évaluations sont publiques, critiquables et mises à jour en fonction des nouvelles données.

- Une culture de l'apprentissage et de la remise en question : Loin d'être dogmatique, la communauté cherche constamment à améliorer ses méthodes.

1.4 Des exemples d'organisations qui peuvent se dire « à impact »

Voici quelques organisations qui respectent nos principes de sélection et peuvent être considérées comme à impact car elles font le meilleur usage des fonds pour aider les autres :

Programmes de supplémentation en vitamine A, ayant été prouvés comme hautement efficaces pour sauver des vies.

Augmentation des taux de vaccination infantile, permettant de doubler la couverture vaccinale.

Recherche en protéines alternatives, défendant une alimentation sans souffrance animale et plus respectueuse de la planète. Ses méthodes et ses résultats ont été de multiples fois reconnus très efficaces par des évaluateurs indépendants.

2. Pourquoi le secteur de l'évaluation en France échoue à remplir son rôle ?

2.1 Désalignements des intérêts

Le but des rapports des évaluations d'impact n'est pas d'aider davantage

L'évaluation en France n'est généralement pas menée dans une démarche d'altruisme ni avec l'objectif premier d'aider le plus efficacement possible. Il ne s'agit pas d'une approche impartiale qui cherche à identifier les meilleures façons d'aider, mais souvent d'une exigence administrative pour obtenir des financements.

Chez Mieux Donner, l'évaluation ne sert pas à produire des chiffres pour justifier des financements ou remplir des rapports, mais à décupler notre impact. Chaque don peut transformer des vies, et analyser avec rigueur les associations nous permet d'identifier celles qui apportent le plus de bien. Ignorer cette réalité reviendrait à accepter d'aider moins alors que nous pourrions aider davantage. Chaque action compte, et c'est en mettant l'efficacité au cœur de nos décisions que nous pouvons réellement faire la différence. Nous espérons que de plus en plus d'acteurs vont se joindre à nous dans cette démarche.

Les associations recherchent avant tout des financements

Les associations ont besoin de fonds pour continuer à exister et mener leurs projets. Mais demander à une association d'évaluer rigoureusement son efficacité revient, dans certains cas, à lui demander de prouver que son projet ne fonctionne pas ou qu'un autre projet aurait eu plus d'impact.

Le paradoxe des incitations :

- Une association qui prouve que son programme est moins efficace qu'un autre risque de perdre des financements.

- Si un projet montre des résultats mitigés, il peut être plus intéressant pour l'association de mettre en avant des témoignages individuels plutôt que des chiffres concrets.

Une culture du « faire » plutôt que du « comparer »

- Dans de nombreux secteurs, l'important est d'agir, de montrer qu'on fait quelque chose, plutôt que d'optimiser l'impact réel de ses actions.

- Une association aura toujours intérêt à prouver qu'elle fait du bien, mais beaucoup moins à comparer son impact avec d'autres solutions alternatives.

Nous verrons dans une prochaine partie que prioriser et chercher à être parmi les plus efficaces peut être un excellent moyen de trouver des financements.

Les cabinets de conseil en mesure d'impact ont intérêt à complexifier les évaluations

Le marché de la mesure d'impact en France repose largement sur des cabinets de conseil qui vendent des études aux associations et aux financeurs. Cependant, leur modèle économique privilégie des évaluations sur-mesure, empêchant toute comparabilité entre les projets. Plutôt que d'adopter des méthodologies standardisées, ces cabinets développent chacun leurs propres outils d'analyse, rendant les résultats opaques et difficiles à confronter.

Pourquoi standardiser reviendrait à remettre en cause ce modèle économique :

- Une méthodologie standard permettant une première estimation en quelques heures réduirait le besoin d'évaluations longues et personnalisées.

- Un cabinet qui conclurait à l'inefficacité d'un projet risquerait de ne plus être sollicité par l'organisation concernée, ce qui crée un fort biais incitant à produire des évaluations favorables.

Un nouveau modèle économique est pourtant envisageable. Certains cabinets pourraient se démarquer en adoptant des méthodologies rigoureuses et transparentes, basées sur des évaluations comparatives et standardisées. Si ces analyses permettaient réellement d'orienter les décisions et de guider les arbitrages, elles deviendraient un véritable outil pour les fondations et les philanthropes.

En exigeant ce type d'évaluation, ces financeurs inciteraient l'ensemble du secteur à évoluer vers des standards plus élevés. Cela créerait une dynamique vertueuse où les associations, soucieuses de leur impact, adopteraient les méthodes les plus efficaces, garantissant ainsi une meilleure utilisation des ressources disponibles.

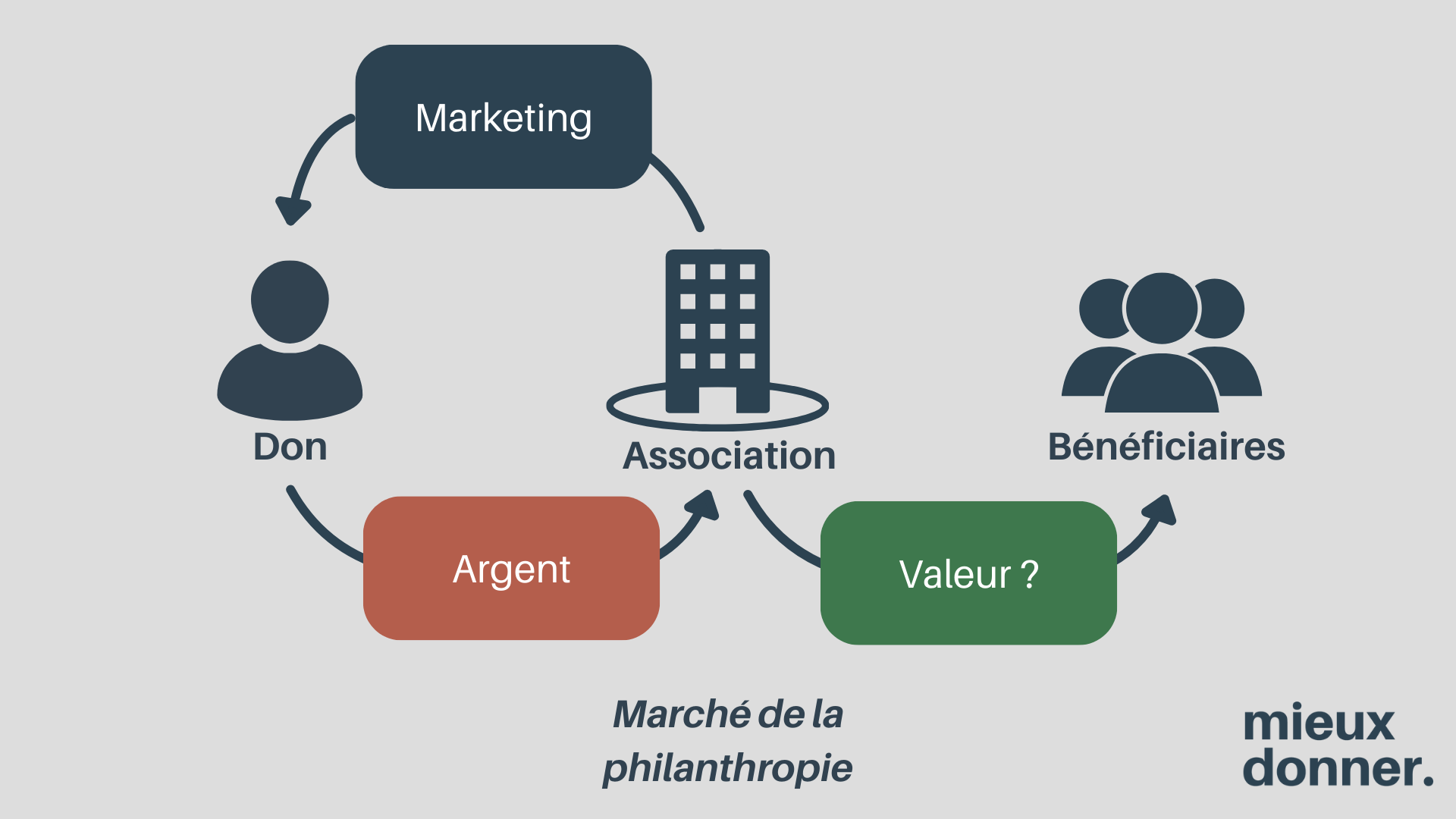

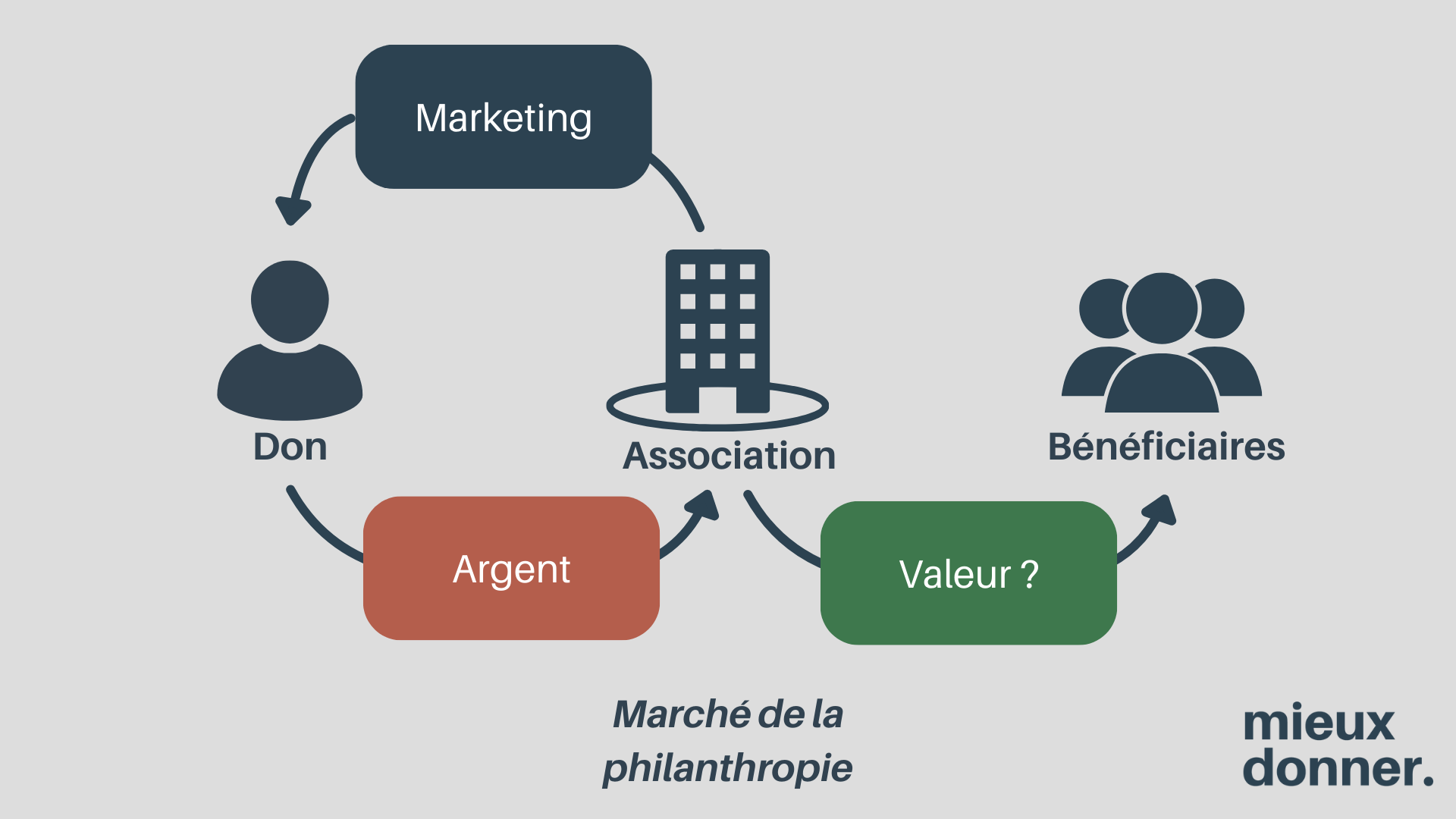

Les personnes qui financent ne sont pas les bénéficiaires finaux

L'argent donné aux associations ne vient pas directement des bénéficiaires, mais d'individus, de fondations ou d'institutions publiques. Ces financeurs ont des motivations et des contraintes différentes de celles des personnes qui reçoivent l'aide.

Pourquoi les financeurs ne poussent pas pour une vraie mesure d'impact ?

- Les individus ont été habitués à donner pour des raisons émotionnelles et sont influencés par des récits convaincants. Mais ils sous-estiment grandement les différences d'impact d'efficacité et même s'ils savaient que deux associations n'ont pas le même impact, ils auraient du mal à en choisir une.

Les risques d'un manque de redevabilité :

- Les financeurs ne sont pas directement affectés par l'inefficacité des interventions : un individu ne voit pas l'impact réel de son argent, il fait confiance aux associations.

- Un mauvais projet n'a pas d'impact sur ceux qui décident : contrairement à une entreprise qui échoue si elle ne répond pas aux besoins de ses clients, une ONG inefficace peut continuer à exister si elle sait bien communiquer et sécuriser des financements.

Cependant, un mouvement croissant en faveur d'une générosité plus efficace se développe en France. En y prenant part, il est possible d'orienter les ressources vers les actions qui transforment le plus de vies et à renforcer une culture de l'impact au service des bénéficiaires.

Conséquences d'un désalignement : Un système qui perpétue l'inefficacité

Dans un marché où les associations doivent avant tout sécuriser leurs financements, la mesure d'impact devient un outil de validation plutôt qu'un moyen de priorisation.

Une vraie mesure d'impact devrait permettre de comparer les interventions entre elles et de rediriger les ressources vers celles qui ont le plus grand effet. Pourtant, cette logique est quasiment absente en France.

Les financeurs n'exigent pas d'indicateurs standardisés permettant de comparer objectivement les projets. Ils se contentent de voir une ligne « évaluation d'impact » dans les dossiers de demande de subvention, sans chercher à comprendre si ces évaluations permettent réellement de mieux allouer les fonds.

×100

Cette absence de mécanisme de sélection est l'une des raisons pour lesquelles il est possible d'avoir, dans une même cause, des écarts d'efficacité pouvant aller jusqu'à 100 fois entre deux projets, sans que ces écarts soient visibles pour les financeurs.

En l'état, le système français de mesure d'impact ne remplit pas son rôle. Il produit des rapports coûteux qui ne permettent pas de prendre de meilleures décisions et qui justifient des financements sans jamais questionner leur efficacité relative.

Conséquences concrètes de ce système :

- Les associations investissent dans des évaluations qui ne les aident pas à amplifier leur impact.

- Les financeurs continuent de financer des projets sans jamais comparer leur efficacité à d'autres alternatives.

- Les cabinets de conseil prospèrent sur un modèle économique qui n'est pas basé vers l'aide des autres.

En conséquence, les ressources ne sont pas allouées aux interventions qui pourraient réellement multiplier l'impact sur les bénéficiaires. Ce système, conçu pour préserver des intérêts existants, ne sert finalement ni les associations ni les personnes dans le besoin.

2.2 Méconnaissance et manque de compétences dans l'évaluation d'impact

Malgré l'existence d'outils et de méthodologies rigoureuses largement utilisées à l'étranger, presque aucun acteur français ne semble les connaître ni les intégrer dans ses pratiques. GiveWell, référence mondiale en évaluation d'associations caritatives, partage pourtant librement ses analyses et ses méthodes en ligne. De même, des bases de données complètes sur l'efficacité des interventions sont accessibles à tous, mais elles restent quasi inconnues des cabinets de conseil français et des acteurs institutionnels de la philanthropie.

Pourtant, il est possible de discuter avec des dizaine de personnes du secteurs sans qu'une seule connaisse GiveWell, même de nom. Pire encore, la majorité des acteurs spécialisés en mesure d'impact ne s'appuie ni sur la littérature scientifique (littérature blanche), ni sur les analyses produites par des organisations comme Founders Pledge (littérature grise), alors qu'une simple recherche permettrait parfois de voir que certaines des interventions qu'ils financent ou évaluent n'ont pas prouvé d'impact positif.

Ce manque de rigueur se retrouve dans le monde académique : on peut obtenir un master en humanitaire en ayant passé que quelques heures sur les approches basées sur les preuves et sans avoir appris à évaluer un projet en quelques critères clés. On obtient son diplôme sans avoir entendu parler de GiveWell, alors que si l'on suit des études pour aider les plus démunis, découvrir les interventions les plus efficaces au monde me semblerait être un bon point de départ.

2.3 Une approche historique et culturelle différente de la philanthropie

L'absence de culture scientifique et de fondation sur les preuves

Les acteurs de la philanthropie en France sont peu connectés au monde académique et scientifique, en particulier lorsqu'il s'agit d'économie du développement. Contrairement aux États-Unis ou au Royaume-Uni, où des think tanks et des universités travaillent main dans la main avec des ONG, en France, ces deux mondes restent largement séparés.

Beaucoup d'acteurs associatifs français continuent de privilégier des approches qualitatives et narratives plutôt que des mesures d'impact chiffrées. L'idée que l'évaluation scientifique puisse remettre en question des pratiques établies est souvent perçue comme une menace plutôt qu'une opportunité.

Le double tranchant d'un État fort : moins d'attention à l'efficacité de la philanthropie

Comment expliquer cette différence avec le monde anglo-saxon ? La France a longtemps été marquée par un modèle où l'État joue un rôle central dans la redistribution et le financement des services sociaux. Historiquement, les grandes avancées en matière de solidarité (sécurité sociale, allocations familiales, santé publique) ont été pilotées par l'État et non par des initiatives privées.

Cette centralisation a conduit à une méfiance persistante envers les acteurs privés, notamment philanthropiques, considérés comme des alternatives concurrentielles aux politiques publiques. En conséquence, la philanthropie en France s'est souvent limitée à un rôle complémentaire, axé sur des actions humanitaires ou sociales sans prétention d'efficacité mesurable.

À l'inverse, dans des pays comme les États-Unis ou le Royaume-Uni, la tradition philanthropique repose davantage sur une approche décentralisée et entrepreneuriale. L'État y a historiquement joué un rôle plus limité dans l'aide sociale, ce qui a laissé place à un secteur philanthropique plus structuré. Dans ces contextes, la mesure d'impact émerge rapidement comme un outil clé pour orienter les financements vers les actions les plus efficaces.

Nous n'avons bien entendu pas besoin d'épouser le modèle anglo-saxon pour profiter de ces découvertes : nous pouvons tout à fait conjuguer un État central avec une aide sociale impactante, abondante et rigoureuse, alimentée par une recherche publique impliquée. Cela ne remplace pas le rôle de l'État, mais cela permet, dans le cadre des projets existants, d'agir avec lucidité. Il serait en effet naïf de croire que le marché libre peut tout. Il ne remplace ni les politiques publiques, ni la redistribution fiscale, ni la régulation des inégalités structurelles.

Une vision du don fondée sur l'intention plus que sur l'impact

En France, le don est souvent perçu comme un acte de solidarité plutôt qu'une action pour aider du mieux que nous pouvons. Le discours dominant dans la philanthropie met en avant l'engagement personnel, le soutien aux causes locales et l'importance de « faire sa part », sans nécessairement interroger l'impact réel des fonds mobilisés. La philanthropie est centrée autour des personnes qui donnent et pas autour des personnes qui sont dans le besoin.

Cette approche se retrouve dans le comportement des dons français, qui privilégient souvent des associations bien implantées, connues du grand public, sans chercher à comparer l'efficacité de leurs actions avec celles d'autres organisations. En l'absence d'une demande forte pour des évaluations rigoureuses, les associations elles-mêmes n'ont que peu d'incitations à adopter des mesures de transparence et de performance coût-bénéfice.

Une absence de pression concurrentielle

Dans les pays où la mesure d'impact est fait pour identifier les meilleures opportunités de dons, les organisations ont tout intérêt à démontrer qu'elles sont plus efficaces que leurs concurrentes pour attirer des fonds. Aux États-Unis, GiveWell, Founders Pledge et d'autres évaluateurs indépendants sont nés de cette dynamique : face à une multitude d'associations cherchant à capter l'attention des grands mécènes, les organisations les plus rigoureuses dans l'évaluation de leur impact ont su se démarquer.

En France, cette logique est quasi inexistante. Les grandes associations bénéficient d'une forte reconnaissance institutionnelle et de financements récurrents, sans avoir besoin de prouver qu'elles sont efficaces. La générosité privée et les financeurs publics privilégient souvent la notoriété et l'ancienneté d'une organisation plutôt que l'analyse de son impact réel, ce qui perpétue le statu quo.

Un paradoxe français : Esther Duflo, Prix Nobel

La France a produit l'une des figures les plus influentes de l'évaluation d'impact en la personne d'Esther Duflo, co-lauréate du prix Nobel d'économie en 2019 avec Abhijit Banerjee et Michael Kremer. Ses travaux ont révolutionné la façon dont les politiques de développement sont évaluées, en mettant en avant l'importance des essais contrôlés randomisés (RCT) pour mesurer avec rigueur l'impact des interventions. Pourtant, son influence est bien plus marquée à l'étranger qu'en France.

Alors que les recherches d'Esther Duflo ont été largement adoptées par des organisations internationales, des gouvernements et des ONG à travers le monde, elles restent étonnamment peu utilisées dans le secteur associatif français. Peu de grandes fondations ou d'acteurs institutionnels intègrent les approches qu'elle a défendues, et encore moins d'associations appliquent les méthodologies qu'elle a popularisées.

Plus frappant encore, certains des plus grands acteurs de la philanthropie en France continuent d'affirmer qu'il est impossible de mesurer l'impact de certaines interventions, notamment dans l'éducation. Or, il y a plus de 30 ans, Michael Kremer – co-lauréat du prix Nobel avec Duflo – a publié des études démontrant qu'il était possible d'évaluer rigoureusement l'efficacité des programmes éducatifs en comparant différentes interventions. Des dizaines d'essais contrôlés randomisés ont depuis confirmé ces résultats, et des organisations comme J-PAL (cofondée par Duflo) ont développé des bases de données sur ce sujet.

3. Propositions pour un secteur de la mesure d'impact qui soit fait pour aider

3.1 Standardisation des indicateurs

Il est essentiel d'adopter des indicateurs reconnus à l'international pour mesurer l'impact de manière objective. L'utilisation systématique de métriques telles que les DALY, LAYS, WELLBY ou le tCO₂e évité permettrait de comparer des interventions très diverses sur une échelle commune. En divisant les résultats par le coût total de l'intervention, il serait possible d'obtenir un ratio coût-efficacité permettant d'identifier les actions les plus rentables et d'orienter les ressources en conséquence.

3.2 Intégration du raisonnement contrefactuel

Pour éviter la surestimation de l'impact, il convient d'intégrer systématiquement une analyse contrefactuelle dans les évaluations. Cette approche consiste à comparer les résultats obtenus grâce à l'intervention à ceux qui se seraient produits en son absence. Cela permet de mesurer l'impact net réel et d'identifier les interventions qui génèrent véritablement un effet positif additionnel.

3.3 Transparence et partage des évaluations

La publication et la centralisation des résultats d'évaluation sont indispensables pour permettre une analyse comparative entre les projets. Un partage ouvert des données renforcerait la capacité des financeurs à identifier les interventions les plus efficaces et à orienter les financements en conséquence. Une base de données commune, accessible aux acteurs concernés, favoriserait une meilleure compréhension de l'impact réel des différentes initiatives.

3.4 Une exigence du côté des personnes qui donnent

Les individus et financeurs ont un rôle clé dans l'adoption d'une véritable mesure d'impact. Plutôt que de financer des projets sur des critères vagues ou émotionnels, ils doivent exiger des preuves rigoureuses d'efficacité. Cela implique de privilégier les organisations qui publient des analyses coût-efficacité, intègrent le raisonnement contrefactuel et utilisent des indicateurs standardisés. En orientant les financements vers les interventions les plus efficaces, ils peuvent décupler leur impact et contribuer à une transformation réelle du secteur associatif.

4. Une opportunité unique : un avantage comparatif

4.1 Multiplier l'impact et tenir la promesse de sa mission

Prioriser, c'est accepter de regarder chaque programme en face : quel est son coût par bénéficiaire ? Existe-t-il une alternative dix, voire cent fois plus efficace ? Fermer ou redimensionner un projet peu performant n'est pas un aveu d'échec ; c'est un acte de fidélité à sa raison d'être. Les organisations qui osent ce tri gagnent un levier formidable : avec le même budget, elles touchent davantage les régions prioritaires, réduisent la mortalité plus rapidement et peuvent se comparer avec honnêteté – là où d'autres restent dans le flou.

J'ai également eu plusieurs cas où des associations, en se mettant à parler en termes de coût-efficacité et en se comparant à d'autres opportunités, ont vu leurs soutiens financiers augmenter. Encore plus étonnant, certaines associations ont décidé de fermer leur programme principal après une évaluation rigoureuse, car ce n'était pas la meilleure utilisation de leurs ressources. Les personnes qui les soutenaient ont été d'autant plus motivées à les soutenir, car elles ont pu constater que leur démarche était sincère.

4.2 Un avantage financier et médiatique : se démarquer dans un écosystème concurrentiel

Sur un marché où les financeurs scrutent la valeur ajoutée de chaque euro, afficher une stratégie de priorisation transparente est un différenciateur puissant : c'est la promesse, chiffres à l'appui, que chaque don génère un impact réel. Les fondations et associations qui adoptent cette approche attirent plus facilement de nouveaux partenaires — jusqu'à plusieurs millions d'euros supplémentaires par an — et bénéficient d'une couverture médiatique rare : « la première fondation française qui ferme un programme populaire pour en financer un cent fois plus efficace » serait un récit marquant.

4.3 Un accompagnement gratuit et pragmatique

Mieux Donner met à disposition une équipe dédiée pour guider chaque structure, quelle que soit sa taille : audit rapide de portefeuille, sélection des indicateurs internationaux adaptés (DALY, tCO₂e, WELLBY, etc.) et construction d'un tableau de priorisation prêt à l'emploi. Nous pouvons former vos équipes aux bases du raisonnement contrefactuel, partageons des modèles de reporting ouverts, puis suivons les progrès et cela, sans facturer un centime, car notre financement est déjà sécurisé et notre seule mission est d'aider.

Cet accompagnement s'adresse aussi aux cabinets de conseil qui souhaitent se différencier : adopter une méthodologie standardisée et transparente est le moyen le plus sûr d'offrir aux clients une valeur mesurable. Rejoindre cette dynamique, c'est accéder à un réseau international d'experts et à des revues par les pairs. Ensemble, nous pouvons transformer la priorisation en norme et prouver qu'efficacité et crédibilité sont les deux faces d'une même pièce.

Vers une nouvelle approche de la mesure d'impact en France

La mesure d'impact en France, telle qu'elle est actuellement pratiquée, apparaît comme une illusion qui détourne les ressources et maintient un statu quo inefficace, au détriment des personnes les plus démunies. En dépit de l'existence d'outils comparables et de méthodologies rigoureuses – telles que l'analyse coût-bénéfice intégrant le raisonnement contrefactuel et l'utilisation d'indicateurs standardisés comme les DALY, LAYS, WELLBY ou le tCO₂e évité – leur adoption reste marginale dans le secteur associatif français.

Les évaluations réalisées sur-mesure par de nombreux cabinets de conseil, dont le modèle économique repose sur l'absence de standardisation et le manque de diffusion des résultats, empêchent une comparaison objective entre projets. Ce système, qui favorise la justification des financements existants plutôt que l'orientation vers des interventions plus performantes, engendre des coûts administratifs et limite la capacité des financeurs à arbitrer entre des initiatives potentiellement très différentes en termes de rendement social.

Par ailleurs, l'absence d'un partage systématique des évaluations et la méconnaissance des approches éprouvées à l'étranger – malgré la disponibilité d'études robustes et la facilité d'accès à ces ressources en ligne – perpétuent un déficit de compétences qui freine toute évolution vers une philanthropie plus rigoureuse.

Les acteurs souhaitant aider, qu'ils soient publics ou privés, doivent ainsi être incités à exiger des évaluations rigoureuses et transparentes. En orientant leurs ressources sur la base d'indicateurs comparables et de méthodes scientifiquement validées, ils pourront contribuer à une réallocation plus pertinente des fonds, afin que chaque euro investi serve réellement à améliorer la vie des plus démunis. Il est temps de repenser le secteur de la mesure d'impact en France pour transformer ce qui est aujourd'hui un outil de justification en un levier puissant pour orienter l'aide vers les interventions qui font réellement une différence.

Soutenez les associations les plus efficaces

Découvrez les associations recommandées par Mieux Donner et maximisez l'impact de vos dons.

Donner maintenant →

✉

Recevez nos conseils chaque mois

Associations recommandées, actualités fiscales, impact de vos dons — directement dans votre boîte mail.

S'inscrire à la newsletter →

Publié le 13 mai 2025. Mis à jour le 21 avril 2026